Table des matières

Parcourir les catégories

Auteurs principaux

Types de capteurs ADAS utilisés aujourd'hui

February 14, 2023

Dans cet article, vous allez découvrir les différents types de capteurs ADAS. Nous couvrirons le sujet de manière suffisamment approfondie pour que vous puissiez :

Comprendre les principaux types de capteurs ADAS utilisés aujourd'hui.

En apprendre plus sur les capteurs et les technologies utilisés pour l'ADAS

Voir comment sont utilisés les capteurs ADAS

Ceci est la partie 2 sur 4 dans cette série. Vous pouvez accéder aux 4 parties grâce à ces liens:

Partie 1: Qu'est-ce que l'ADAS?

Partie 2: Types de capteurs ADAS utilisés aujourd'hui (cet article)

Partie 3: Comment les systèmes ADAS sont-ils testés

Partie 4: Protocoles et normes de sécurité ADAS

Principaux types de capteurs ADAS utilisés aujourd'hui

Pour aller droit au but, voici la liste des principaux types de capteurs ADAS utilisés aujourd'hui :

Caméras vidéo

SONAR (alias Ultrasons)

RADAR

LiDAR

Capteurs GPS/GNSS (interface satellite)

Nous allons examiner de plus près chacun de ces éléments dans les sections suivantes.

Un véhicule a besoin de capteurs pour remplacer ou augmenter les sens du conducteur humain. Nos yeux sont le principal capteur que nous utilisons lorsque nous conduisons, mais bien sûr, les images stéréoscopiques qu'ils fournissent doivent être traitées dans notre cerveau pour déduire la distance relative et les vecteurs dans un espace tridimensionnel.

Nous utilisons également nos oreilles pour détecter les sirènes, les klaxons des autres véhicules, les sonneries des passages à niveau, etc. Toutes ces données sensorielles entrantes sont traitées par notre cerveau et intégrées à notre connaissance des règles de conduite afin que nous puissions conduire correctement le véhicule et réagir à l'imprévu.

Les systèmes ADAS doivent faire de même. Les voitures sont de plus en plus équipées de capteurs RADAR, SONAR et LiDAR, ainsi que de données de position absolue fournies par des capteurs GPS et de données inertielles fournies par des capteurs IMU. Les ordinateurs de traitement qui recueillent toutes ces informations et créent des sorties pour aider le conducteur ou prendre des mesures directes sont de plus en plus puissants et rapides pour gérer les tâches complexes liées à la conduite.

La quantité de données de capteurs que les voitures et les véhicules commerciaux d'aujourd'hui traitent est stupéfiante, et elle ne cesse d'augmenter. Même les chiffres impressionnants du graphique ci-dessous seront éclipsés par les véhicules entièrement autonomes du futur.

Caméras vidéo (alias capteurs d'images optiques)

La première utilisation des caméras dans les automobiles a été la caméra de recul, aussi appelée "caméra arrière". Associée à un écran vidéo plat sur le tableau de bord, cette caméra permet aux conducteurs de reculer en toute sécurité dans une place de parking ou de négocier toute manœuvre impliquant une marche arrière. Mais la première motivation initiale était d'améliorer la sécurité des piétons. Selon le ministère des transports, plus de 200 personnes sont tuées et au moins 12 000 autres sont blessées chaque année parce qu'une voiture leur est rentrée dedans. Ces victimes sont principalement des enfants et des personnes âgées à mobilité réduite.

Autrefois installées uniquement dans les voitures haut de gamme, les caméras de recul sont obligatoires dans tous les véhicules vendus aux États-Unis depuis mai 2018. Le Canada a adopté une exigence similaire. La Commission européenne s'oriente vers l'obligation d'une caméra de recul ou d'un système de surveillance dans toutes les voitures, camionnettes, camions et bus en Europe d'ici 2022. Le ministère des Transports au Japon exige des capteurs de recul (une caméra, des capteurs à ultrasons ou les deux) sur toutes les automobiles vendues au Japon d'ici mai 2022.

Mais dans les véhicules ADAS d'aujourd'hui, il peut y avoir plusieurs caméras, orientées dans différentes directions. Et elles ne servent plus seulement à assurer la sécurité des passagers : leurs résultats sont utilisés pour construire un modèle tridimensionnel de l'environnement du véhicule dans le système informatique ADAS. Les caméras sont utilisées pour la reconnaissance des panneaux de signalisation, la lecture des lignes et autres marquages sur la route, la détection des piétons, des obstructions, et bien plus encore. Elles peuvent également être utilisées à des fins de sécurité, de détection de la pluie et d'autres fonctions pratiques.

Dans cette capture d'écran d'un système de caméra Mobileye, vous pouvez voir comment le système identifie et étiquette les véhicules et les piétons, et détermine que le feu de circulation est vert.

La sortie de la plupart de ces caméras n'est pas visible par le conducteur. Elle alimente plutôt le système informatique ADAS. Ces systèmes sont programmés pour traiter le flux d'images et identifier les panneaux d'arrêt, par exemple, et pour comprendre qu'un autre véhicule signale un virage à droite et qu'un feu de circulation vient de passer au orange, etc. Ils sont largement utilisés pour détecter les marquages au sol, ce qui est essentiel pour l'assistance au maintien de la trajectoire. Il s'agit d'une quantité énorme de données et de puissance de traitement, qui ne fait qu'augmenter dans la marche vers les voitures à conduite autonome.

Plusieurs types de capteurs sont utilisés aujourd'hui, principalement les capteurs CMOS et CCD. Les capteurs CCD offrent une plage dynamique et une résolution supérieures. Cependant, les capteurs CMOS ne nécessitent pas autant d'énergie et peuvent être moins chers en raison de leur architecture en silicium. Les deux technologies sont construites autour d'une matrice rectangulaire de pixels qui émettent un courant proportionnel à l'intensité de la lumière focalisée sur ce pixel.

De nombreuses caméras de véhicules ont été adaptées pour mieux voir dans l'obscurité que les êtres humains, en substituant un capteur blanc au capteur vert typique dans un capteur optique RVB. Les principaux fabricants de capteurs pour caméras de véhicules sont Mobileye (une société israélienne rachetée pour 15,3 milliards de dollars par Intel en 2017) et OmniVision. Mobileye a déclaré que si un humain peut conduire une voiture en utilisant uniquement la vision, alors un ordinateur le peut aussi. Et contrairement à un conducteur humain, les caméras peuvent regarder dans toutes les directions en même temps.

Regardez cette vidéo produite par Mobileye, qui montre une conduite entièrement autonome et inédite de 40 minutes à travers Jérusalem, à l'aide de son système à 12 caméras. Un conducteur est au volant pour des raisons de sécurité, mais il ne touche jamais les commandes avant la fin de la démonstration.

Tesla a décidé d'utiliser des capteurs optiques passifs basés sur le RADAR (caméras vidéo) au lieu du LiDAR. Leur position est que, parce qu'il fonctionne en projetant des photons dans le spectre visuel, le LiDAR est susceptible d'être perturbé par des occlusions dues à la pluie, à la poussière, à la neige, etc. Bien sûr, les caméras aussi, mais Tesla utilise le RADAR qui peut voir à travers ces occlusions pour imprimer la portée des objets détectés sur le monde 3D créé par les caméras.

La vision est absolument nécessaire aux êtres humains pour conduire une voiture, mais il existe d'autres façons de "voir". Par exemple, les chauves-souris, les baleines, les dauphins et d'autres animaux utilisent une forme d'écholocation pour naviguer. Les sous-marins émettent des SONAR (ondes sonores de pression) et mesurent ensuite leur retour après avoir rebondi sur le fond de l'océan et d'autres objets. Les avions utilisent le RADAR pour faire rebondir de la même manière des signaux de radiofréquence afin de détecter et de mesurer la distance par rapport au sol, à d'autres avions, etc.

Le rebondissement des ondes sur les objets environnants et la mesure de leur temps de retour sont au cœur des capteurs de télémétrie. Le RADAR utilise les ondes radio, le LiDAR la lumière et le SONAR (ou ultrasons) l'énergie acoustique. Toutes ces méthodes de détection sont utilisées dans diverses combinaisons par les véhicules actuels équipés de systèmes d'aide à la conduite.

Même Mobileye, qui est à l'avant-garde de l'utilisation des caméras, se développe en parallèle avec les capteurs LiDAR, créant ainsi deux systèmes complètement indépendants pour créer un modèle en temps réel de l'environnement qui exploite le meilleur des deux technologies.

Capteurs SONAR / Ultrasons

Les capteurs SONAR (Sound Navigation and Ranging), aussi appelés "ultrasons", génèrent des sons à haute fréquence de l'ordre de 48 kHz, soit plus de deux fois la gamme d'audition humaine typique. (Il est intéressant de noter que de nombreux chiens peuvent entendre ces capteurs, mais qu'ils ne semblent pas en être gênés). Lorsqu'ils sont commandés par le calculateur de la voiture, ces capteurs émettent une salve d'ultrasons, puis ils "écoutent" les réflexions des objets proches.

En mesurant les réflexions de cet audio, ces capteurs peuvent détecter les objets qui se trouvent à proximité du véhicule. Les capteurs à ultrasons sont beaucoup utilisés dans les détecteurs de recul et les capteurs de stationnement automatique des voitures, des camions et des bus. Ils sont situés à l'avant, à l'arrière et dans les coins des véhicules.

Comme ils fonctionnent en déplaçant l'air puis en détectant les réflexions acoustiques, ils sont idéaux pour les applications à faible vitesse, lorsque l'air autour du véhicule ne se déplace généralement pas très vite. Comme ils sont de nature acoustique, les performances des ultrasons peuvent être dégradées par l'exposition à un environnement extrêmement bruyant.

Les capteurs à ultrasons ont une portée limitée par rapport au RADAR, c'est pourquoi ils ne sont pas utilisés pour les mesures nécessitant une distance, comme les régulateurs de vitesse automatiques ou la conduite à grande vitesse. Mais si l'objet se trouve dans un rayon de 2,5 à 4,5 mètres (8,2 à 14,76 pieds) du capteur, les ultrasons constituent une alternative moins coûteuse au RADAR. Les capteurs à ultrasons ne sont pas utilisés pour la navigation car leur portée est limitée et ils ne peuvent pas détecter les objets plus petits que 3 cm (1,18 in).

Il est intéressant de noter que le constructeur de voitures électriques Tesla a inventé un moyen de projeter des ultrasons à travers le métal, ce qui lui permet de dissimuler ces capteurs partout dans ses voitures, afin de préserver l'esthétique du véhicule. Les disques ronds sur les pare-chocs de la voiture dans l'image ci-dessus sont des capteurs à ultrasons.

Capteurs RADAR

Les capteurs RADAR (Radio Detection and Ranging) sont utilisés dans les véhicules équipés de l'ADAS pour détecter les gros objets devant le véhicule. Ils utilisent souvent une fréquence RADAR de 76,5 GHz, mais d'autres fréquences de 24 GHz à 79 GHz sont également utilisées.

Deux méthodes de base de détection RADAR sont utilisées :

propagation directe

propagation indirecte

Dans les deux cas, ils fonctionnent en émettant ces fréquences radio et en mesurant le temps de propagation des réflexions renvoyées. Cela leur permet de mesurer à la fois la taille et la distance d'un objet et sa vitesse relative.

Applications pour le RADAR automobile

Les signaux RADAR pouvant atteindre une portée de 300 mètres devant le véhicule, ils sont particulièrement importants lors de la conduite à grande vitesse sur autoroute. Leurs fréquences élevées signifient également que la détection des autres véhicules et des obstacles est très rapide. En outre, le RADAR peut "voir" à travers le mauvais temps et d'autres obstacles à la visibilité. Comme leurs longueurs d'onde ne font que quelques millimètres, ils peuvent détecter des objets de plusieurs cm ou plus.

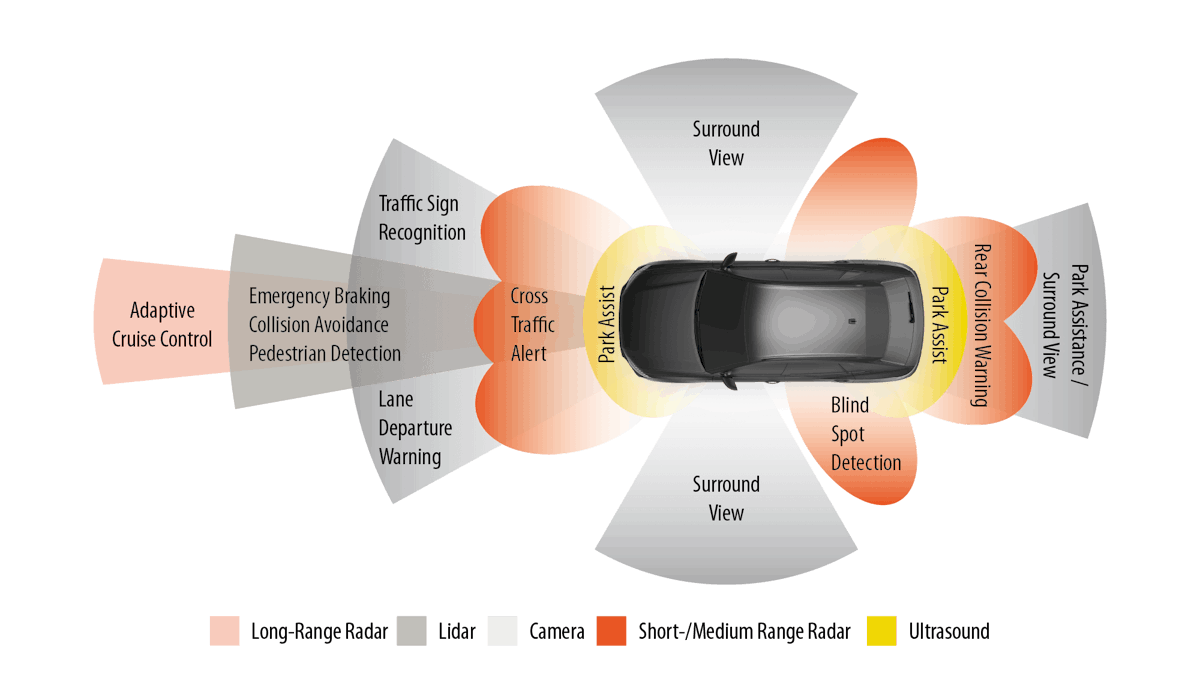

Le RADAR est particulièrement efficace pour détecter les objets métalliques, comme les voitures, les camions et les bus. Comme le montre l'image ci-dessus, ils sont essentiels pour l'alerte et l'atténuation des collisions, la détection des angles morts, l'assistance au changement de voie, l'assistance au stationnement, le régulateur de vitesse adaptatif (ACC), etc.

Capteurs LiDAR

Les systèmes LiDAR (Light Detection and Ranging) sont utilisés pour détecter des objets et cartographier leurs distances en temps réel. Essentiellement, le LiDAR est un type de RADAR qui utilise un ou plusieurs lasers comme source d'énergie. Il convient de noter que les lasers utilisés sont les mêmes types de lasers sans danger pour les yeux que ceux utilisés à la caisse des magasins d'alimentation.

Les capteurs LiDAR haut de gamme tournent, émettant des faisceaux laser sans danger pour les yeux dans toutes les directions. Le LiDAR utilise un récepteur à temps de propagation de la lumière qui mesure le temps de réflexion.

Une IMU et un GPS sont généralement intégrés au LiDAR afin que le système puisse mesurer le temps que mettent les faisceaux à rebondir et prendre en compte le déplacement du véhicule dans l'intervalle, pour construire un modèle 3D haute résolution de l'environnement de la voiture appelé "nuage de points". Des milliards de points sont capturés en temps réel pour créer ce modèle 3D, balayant l'environnement jusqu'à 300 mètres (984 ft.) autour du véhicule, avec une précision de quelques centimètres (~1 in.).

Les capteurs LiDAR peuvent être équipés d'un maximum de 128 lasers. Plus il y a de lasers, plus la résolution du nuage de points 3D peut être élevée.

En plus de la technologie LiDAR à rotation inventée par Velodyne, il existe aujourd'hui des LiDAR à semi-conducteurs sur le marché. En fait, Velodyne propose elle-même plusieurs capteurs LiDAR. Un autre développeur est Quanergy, qui fabrique un LiDAR à base de CMOS qui utilise la technologie de réseau optique à commande de phase pour guider chaque impulsion laser dans une direction choisie plutôt que de faire tourner un miroir.

Le LiDAR peut détecter des objets avec beaucoup plus de précision que le RADAR ou les capteurs à ultrasons, mais ses performances peuvent être dégradées par les interférences de la fumée, du brouillard, de la pluie et d'autres occlusions dans l'atmosphère. Mais, comme ils fonctionnent indépendamment de la lumière ambiante (ils projettent leur propre lumière), ils ne sont pas affectés par l'obscurité, les ombres, la lumière du soleil ou les phares des véhicules venant en sens inverse.

Les capteurs LiDAR sont généralement plus chers que les RADAR en raison de leur relative complexité mécanique. Ils sont de plus en plus utilisés en conjonction avec des caméras car les LiDAR ne peuvent pas détecter les couleurs (comme celles des feux de circulation, des feux stop rouges et des panneaux de signalisation), ni lire le texte aussi bien que les caméras. Les caméras peuvent faire ces deux choses, mais elles ont besoin d'une plus grande puissance de traitement derrière elles pour effectuer ces tâches.

Capteurs GPS/GNSS

Pour faire des véhicules à conduite autonome une réalité, nous avons besoin d'un système de navigation de haute précision. Les véhicules actuels utilisent le Global Navigation Satellite System (GNSS). Le GNSS est bien plus que le "GPS" que tout le monde connaît.

Le GPS,qui signifie Global Positioning System, est une constellation de plus de 30 satellites qui tournent autour de la planète. Chaque satellite émet en permanence des données de temps et de position extrêmement précises. Lorsqu'un récepteur reçoit des signaux utilisables d'au moins quatre de ces satellites, il peut trianguler sa position. Plus il reçoit de signaux utilisables, plus les résultats sont précis.

Mais le GPS n'est pas le seul système de positionnement mondial. Il existe de multiples constellations de satellites GNSS en orbite autour de la terre en ce moment :

GPS - États-Unis

GLONASS - Russie

Galileo - Europe

BeiDou - Chine

Les meilleurs systèmes GNSS installés dans les véhicules actuels ont la capacité d'utiliser deux ou trois de ces constellations. L'utilisation de fréquences multiples permet d'obtenir les meilleures performances possibles car elle réduit les erreurs dues aux retards de signal, qui sont parfois causés par des interférences atmosphériques. En outre, comme les satellites sont toujours en mouvement, les grands immeubles, les collines et autres obstacles peuvent bloquer une constellation donnée à certains moments. Par conséquent, la possibilité d'accéder à plus d'une constellation atténue ces interférences.

Voici la gamme de fréquences des constellations GNSS les plus populaires aujourd'hui :

Le GNSS grand public (non militaire) offre une précision de position d'environ un mètre (39 pouces). C'est très bien pour le système de navigation typique d'un véhicule à propulsion humaine. Mais pour une véritable autonomie, nous avons besoin d'une précision centimétrique.

La précision du GNSS peut être améliorée en utilisant un système d'augmentation régional ou localisé. Il existe aujourd'hui des systèmes terrestres et spatiaux qui fournissent une augmentation du GNSS. Les systèmes d'augmentation au sol sont connus collectivement sous le nom de GBAS, tandis que les systèmes d'augmentation par satellite ou basés dans l'espace sont connus collectivement sous le nom de SBAS.

Voici quelques-uns des systèmes SBAS utilisés aujourd'hui :

WAAS (Wide Area Augmentation System) - géré par la FAA aux États-Unis, ce système utilise un système de stations de référence au sol situées dans le monde entier pour transmettre des valeurs de correction aux satellites WAAS. Les récepteurs GNSS compatibles WAAS peuvent utiliser ces données pour améliorer la précision du GPS.

EGNOS (European Geostationary Navigation Overlay Service) - un SBAS développé par l'Agence spatiale européenne. Ce système de correction sera intégré au GNSS européen Galileo à l'avenir.

MTSAT (Multi-functional Satellite Augmentation System) - un SBAS développé par le Japon.

StarFire - SBAS développé par la société John Deere principalement pour les véhicules agricoles, qui sont de gros utilisateurs de GPS

OmniStar - un commercial, basé sur un abonnement SBAS, qui couvre la majeure partie du globe

Atlas - un commercial, sur abonnement, qui couvre la majeure partie de la terre

Certains des systèmes GBAS utilisés aujourd'hui :

Le DGPS (Differential GPS) est un GBAS souvent installé dans les aéroports pour fournir un positionnement très précis des avions sur les approches et les pistes. (Un système d'atterrissage basé sur un GBAS est appelé GLS.) De nombreux avions de Boeing et d'Airbus sont équipés de systèmes d'atterrissage automatique GLS.

Le NDGPS (Nationwide Differential GPS System) est un GBAS disponible sur les routes et les voies navigables, géré par la FHA (Federal Highway Administration) aux États-Unis.

Le capteur GNSS INS1000 d'ACEINNA est un excellent exemple de la manière dont les systèmes GNSS, IMU et d'augmentation sont aujourd'hui intégrés dans les capteurs ADAS. Il s'agit d'un GNSS avec RTK L1/L2 à double fréquence et d'une IMU basé sur des gyroscopes et accéléromètres MEMS internes. Il est compatible avec les constellations GNSS GPS, GLONASS, Beidou et Galileo ainsi qu'avec l'augmentation SBAS.

Avec la correction RTK, il revendique une précision de positionnement de 2 cm (0,78 pouces).

Quelques exemples de la façon dont le GNSS et les autres capteurs ADAS fonctionnent ensemble:

Lorsque nous entrons dans un parking ou un tunnel couvert, les signaux GNSS provenant du ciel sont complètement bloqués par le toit. Les capteurs IMU (unité de mesure inertielle) peuvent détecter les changements d'accélération dans tous les axes et calculer la position du véhicule jusqu'au retour des satellites. La précision de l'estimation à l'aveugle dérive avec le temps, mais elle est très utile pour les courtes durées pendant lesquelles le système GNSS est "aveugle".

En conduisant dans n'importe quelles conditions, les caméras, les capteurs LiDAR, SONAR et RADAR peuvent fournir une précision de position de l'ordre du centimètre que le GNSS ne peut tout simplement pas fournir (sans correction par un RTK). Ils peuvent également détecter d'autres véhicules, des piétons, etc. - Ce que le GNSS n'est pas censé faire car les satellites ne sont pas des capteurs - ils signalent simplement leur heure et leur position avec une grande précision.

Dans les villes, les bâtiments créent ce qu'on appelle un "canyon urbain" où les signaux GNSS rebondissent, ce qui entraîne des interférences par trajets multiples (le même signal atteint l'antenne GNSS à différents moments, ce qui perturbe le processeur). Dans ces conditions, l'IMU peut faire un point mort et fournir des données de position vitales, tandis que les autres capteurs (caméras, LiDAR, RADAR et SONAR) continuent à détecter le monde qui entoure le véhicule de tous côtés.

Réflexions sur les capteurs ADAS

Une voiture à propulsion humaine fonctionne parce que nous avons une vision stéréoscopique et sommes capables de déduire la distance et la vitesse relatives dans notre cerveau. Même avec un œil fermé, nous pouvons déduire la distance et la taille en utilisant la vision monoculaire de manière assez précise, car notre cerveau est entraîné par l'expérience du monde réel.

Nos yeux et notre cerveau nous permettent également de lire et de réagir à des panneaux et de suivre des cartes, ou simplement de nous souvenir de la direction à prendre parce que nous connaissons la région. Nous savons comment vérifier rapidement les rétroviseurs afin de pouvoir voir dans plus d'une direction sans tourner la tête.

Notre cerveau connaît les règles de la conduite. Nos oreilles peuvent entendre les sirènes, les klaxons et d'autres sons, et notre cerveau sait comment réagir à ces sons dans leur contexte. En parcourant simplement une courte distance pour acheter du lait et du pain, un conducteur humain prend des milliers de décisions et effectue des centaines de réglages mécaniques, petits et grands, à l'aide des commandes manuelles et au pied du véhicule.

Remplacer les capteurs optiques et auditifs connectés à un cerveau composé d'environ 86 milliards de neurones n'est pas une mince affaire. Cela nécessite une série de capteurs et un traitement très avancé, rapide, exact et précis. Les voitures véritablement autonomes sont développées pour apprendre de leur expérience, comme le font les êtres humains, et pour intégrer ces connaissances dans leur comportement.

Chacun des capteurs utilisés dans les véhicules ADAS présente des forces et des faiblesses, des avantages et des inconvénients :

Le LiDAR est excellent pour voir en 3D et fonctionne bien dans l'obscurité, mais il ne peut pas voir la couleur. Le LiDAR peut détecter de très petits objets, mais ses performances sont dégradées par la fumée, la poussière, la pluie, etc. dans l'atmosphère. Ils nécessitent moins de traitement externe que les caméras, mais ils sont aussi plus chers que ces dernières.

Les caméras peuvent voir si le feu de circulation est rouge, vert ou orange, et d'autres couleurs. Elles sont très efficaces pour "lire" les panneaux et voir les lignes et autres marquages. Mais elles sont moins efficaces pour voir dans l'obscurité, ou lorsque l'atmosphère est dense avec du brouillard, de la pluie, de la neige, etc. Ils nécessitent également plus de traitement que le LiDAR.

Le RADAR peut voir plus loin sur la route que les autres capteurs de télémétrie, ce qui est essentiel pour la conduite à grande vitesse. Ils fonctionnent bien dans l'obscurité et lorsque l'atmosphère est masquée par la pluie, la poussière, le brouillard, etc. Ils ne peuvent pas faire des modèles aussi précis que les caméras ou les LiDAR, ni détecter de très petits objets comme le font les autres capteurs.

Les capteurs SONAR sont excellents pour la télémétrie de proximité, comme les manœuvres de stationnement, mais pas pour les mesures de distance. Ils peuvent être perturbés par le bruit du vent et ne fonctionnent donc pas bien à des vitesses élevées du véhicule.

Le GNSS, associé à une base de données cartographiques fréquemment mise à jour, est essentiel pour la navigation. Mais une précision brute du GNSS d'un mètre ou plus n'est pas suffisante pour une conduite entièrement autonome, et sans une ligne de visée vers le ciel, ils ne peuvent pas naviguer du tout. Pour la conduite autonome, ils doivent être intégrés à d'autres capteurs, notamment l'IMU, et être complétés par un système RTK, SBAS ou GBAS.

Les systèmes IMU fournissent le repérage à l'aveugle dont les systèmes GNSS ont besoin lorsque la ligne de visée vers le ciel est bloquée ou perturbée par les trajets multiples des signaux dans le "canyon urbain".

Ces capteurs se complètent les uns les autres et permettent au processeur central de créer un modèle tridimensionnel de l'environnement autour du véhicule, de savoir où aller et comment s'y rendre, de respecter les règles de conduite et de réagir aux événements attendus et inattendus qui se produisent sur chaque route et chaque parking.

En bref, nous avons besoin de tous ces éléments, ou d'une combinaison d'entre eux, pour parvenir à l'ADAS et, à terme, à la conduite autonome.

Résumé

Quand vous étiez enfant, avez-vous pensé que votre voiture familiale serait équipée d'un RADAR et d'un SONAR comme les avions et les sous-marins ? Saviez-vous même ce qu'était le LiDAR ? Imaginiez-vous des écrans plats dominant le tableau de bord et un système de navigation relié à des satellites dans l'espace ? Tout cela aurait ressemblé à de la science-fiction, et aurait été totalement hors de portée pendant au moins 100 ans. Mais aujourd'hui, tout cela et bien plus encore est une réalité.

L'ADAS est le type de développement le plus important à l'heure actuelle. Bien sûr, il y a en parallèle les développements de l'énergie hybride et électrique, qui sont aussi extrêmement importants pour réduire les gaz à effet de serre et l'utilisation des combustibles fossiles. Il est difficile de citer un constructeur automobile qui ne vend pas déjà des versions électriques de ses voitures, ou qui n'en est qu'aux derniers stades de développement.

Mais l'ADAS touche directement à l'aspect le plus important des déplacements : la sécurité humaine. Étant donné que plus de 90 % des accidents de la route, des blessures et des décès sont dus à une erreur humaine, chaque avancée en matière d'ADAS a un effet clair et absolu sur la prévention des blessures et des décès.

Ceci est la partie 2 sur 4 dans cette série. Vous pouvez accéder aux 4 parties grâce à ces liens:

Partie 1: Qu'est-ce que l'ADAS?

Partie 2: Types de capteurs ADAS utilisés aujourd'hui (cet article)

Partie 3: Comment les systèmes ADAS sont-ils testés

Partie 4: Protocoles et normes de sécurité ADAS